九游体育娱乐网每个时辰步的信息被等权地压缩进澌灭个荫藏情状-九游体育(中国)Ninegame官方网站-登录入口

科技博主Avi Chawla在X上发了一条长帖,防卫拆解了月之暗面Kimi团队刚刚发布的一篇技巧讲解。

帖子发出后不久,马斯克本东说念主不才面回复了一句:“月之暗面作念出了令东说念主印象深切的适度”(Impressive work from Kimi.)

马斯克在AI领域的表态向来以抉剔著称,没少骂过Anthropic和OpenAI,致使曾直言说Anthropic的图标像是某种东说念主体器官。

他我方的xAI最近还在阅历大鸿沟重组,多位华东说念主鸠合创举东说念主辞职,Grok的进展也不尽如东说念观念。

可就在这个节骨眼上,他主动对一家中国AI公司的技巧论文暗示招供,若干有些出东说念主预感。

说回被马斯克点赞的这个东西,其实是有点抽象的,因为它根蒂不是一个模子。

Kimi团队提议了一种新的形势,试图替换掉Transformer架构里一个自2015年以来就险些没东说念主动过的基础组件。

这是一篇纯正的架构层面的技巧论文。

固然说这篇论文的影响,偶而会被平方用户感知到,可施行上,它触碰的是所有这个词深度学习的基石。

01

月之暗面到底改了什么

要连络这篇论文在作念什么,得先搞明晰一个布景。当代大谈话模子,不管是GPT、Claude,照旧国内的豆包、DeepSeek,哪怕是Kimi我方的K2.5,其底层架构皆是Transformer。

Transformer之是以能进修到几十层致使上百层而不崩溃,皆是因为一个叫“残差勾通(Residual Connection)”的机制在起作用。

残差勾通的道理其实很浅薄。

每一层网络在作念完我方的遐想之后,把我方的输出和输入加在通盘,然后传到下一层去再作念遐想。这么作念的公正是,梯度在反向传播时不错沿着一条“高速公路”直达底层,不会因为层数太深而隐匿。

这个遐想来自何恺明在2015年参与的ResNet论文,自后被Transformer如法泡制地秉承了下来。

但这时候就有一个不大不小的问题,这种“加法”是十足对等的。

第一层的输出和第四十层的输出,在最终的荫藏情状里享有同等的权重,皆是1。莫得任何机制去判断哪一层的信息更紧要、哪一层的孝敬不错被忽略。跟着层数加多,荫藏情状的数值会线性增长,早期层的信息逐渐被稀释,后头的层想要产生影响就必须输出更大的数值,这反过来又加重了不踏实性。

就像我们所有这个词东说念主拉个微信群,通盘磋磨晚上吃什么,每个东说念主的发言权重十足一样,不管谁说的有道理谁在乱说,临了群主只可把所有这个词音讯重新到尾读一遍,这就导致他越往后翻越记不住前边说了啥。

这个安谧在学术上被称为“PreNorm稀释”。

Kimi团队戒备到,这个问题和早年RNN面对的窘境有一种结构上的对称性。

RNN是在时辰维度上作念固定权重的累加,每个时辰步的信息被等权地压缩进澌灭个荫藏情状,导致长距离依赖难以捕捉。自后Transformer用戒备力机制替代了RNN的这种线性累加,让模子不错凭据内容动态地决定该关注序列中的哪些位置,这才有了自后的一切。

两者的分辨在于,RNN就像上课,诚实讲到哪你就听到哪,只可重新听到尾,没记着的要么看札记,要么再次重新来。Transformer则是录播网课,不错随时翻且归看之前最紧要的部分。

但在深度维度上,不异的问题一直存在,却莫得东说念主用不异的想路去科罚。每一层的输出仍然是被等权相加的,模子莫得材干凭据现时输入去选拔性地从某些层索取信息、忽略另一些层。

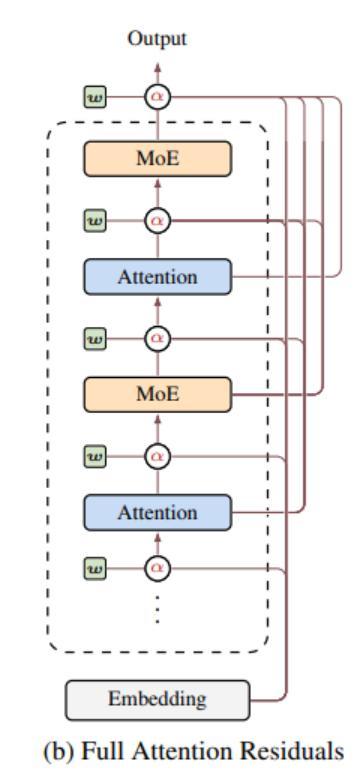

Kimi团队暗示,圭臬残差勾通骨子上是“深度维度上的线性戒备力”,他们要作念的,是把它升级为“深度维度上的softmax戒备力”。

于是他们提议了一个“期望版”的决策,叫作念全戒备力残差(Full Attention Residuals)。

具体作念法是给每一层赋予一个可学习的查询向量,这个向量会对之前所有这个词层的输出作念一次戒备力遐想,产生一组归一化的权重。

然后现时层的输入不再是之前所有这个词层输出的浅薄乞降,而是按照这组权重的加权组合。权重是输入关联的,也等于说,不同的token在经过澌灭层时,可能会从不同的历史层中索取不同的信息。

那我们照旧用前边微信群的例子。目下群主无谓重新到尾翻聊天记载了,有个助手帮他标出“这几条最值得看”,不同的话题还会标出不同的重心音讯。

期望丰润现实骨感,全戒备力残差这个决策其实“不靠谱”。

大鸿沟进修时,模子通常会使用活水线并行和激活重遐想来从简显存,这意味着之前层的输出不会被保留在内存里。

要是要作念全戒备力,就需要把所有这个词层的输出皆存下来并在活水线的不同阶段之间传递,内存和通讯支出皆会变得不可继承。

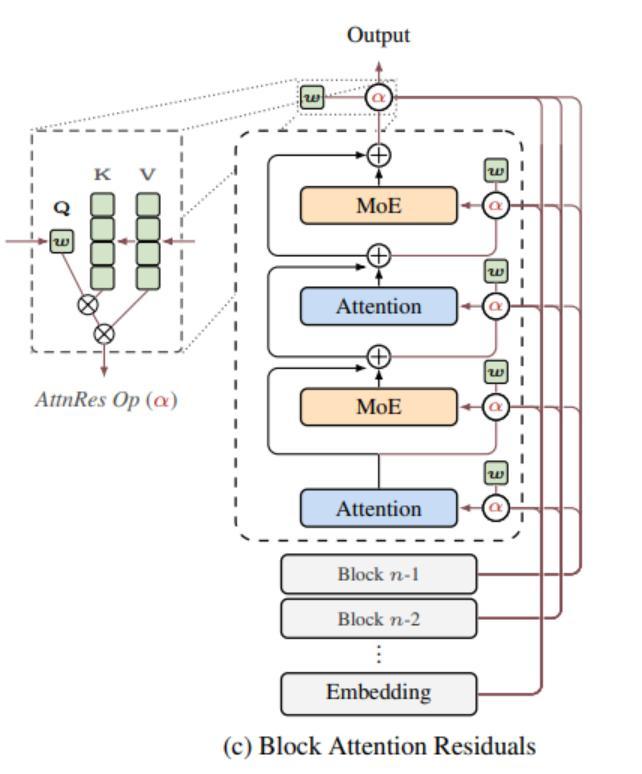

为了科罚这个问题,Kimi团队又提议了块戒备力残差(Block Attention Residuals)。

想路是把所有这个词层分红若干个块,每个块里面仍然使用传统的残差勾通作念乞降,但块与块之间使用戒备力机制来作念选拔性团聚。这么需要存储和传输的不再是每一层的输出,而是每个块的汇总暗示,内存占用从 O(Ld)降到了 O(Nd),其中 N 是块的数目,通常惟有8个傍边。

这就荒谬于是把刚才阿谁微信群分红了八个小组,每组先里面磋磨出一个论断,群主只需要看八条小组回归就行。

在此基础上,他们还作念了一系列工程优化。

比如跨阶段缓存摒除了活水线并行中的冗余传输,两阶段推理战略通过在线softmax把跨块戒备力的遐想分担到各个块的处理经由中。最终的适度是,戒备力残差看成圭臬残差勾通的替代品,进修时的迥殊支出很小,推理时的延伸加多不到2%。

Kimi团队又作念了两个实验。

一是scaling law实验,考据这个改良在不同模子鸿沟下是否一致有用。适度走漏,戒备力在所有这个词遐想预算下皆优于基线,其成果荒谬于用1.25倍的遐想量进修出的基线模子。

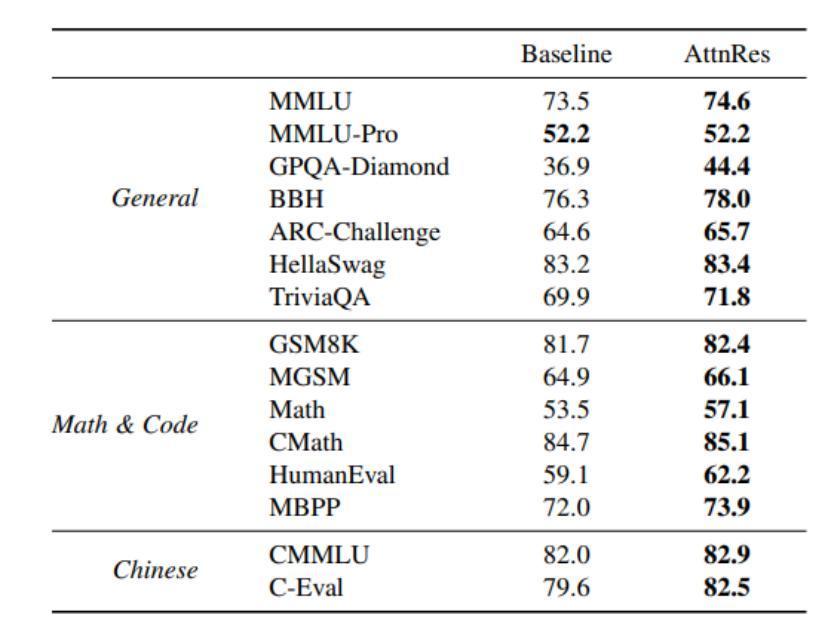

二是Kimi拿我方的大模子上作念了实战考据。模子参数目为480亿,用普及一万亿个词的数据作念了齐全的预进修。然后在科学问答、数学推理、代码生成、详尽常识等一系列主流测试中,加了块戒备力残差的版块全面普及了没加的版块。

从进修动态的分析来看,块戒备力残差如实缓解了PreNorm稀释问题。各层输出的幅度不再随深度线性增长,而是保握在一个相对踏实的范围内;梯度的散播也愈加均匀,也不相逢出现浅层梯渡过大、深层梯渡过小的失衡安谧。

除此之外,论文中还作念了一个长入的结构化矩阵分析,诠释了圭臬残差勾通和之前的各式变体(比如 Highway Networks、DeepNet 的 scaled residuals 等)骨子上皆是深度维度上的线性戒备力的特例。

浅薄来说等于,自2015年ResNet以来,在残差勾通这个板块,莫得任何实质性的变化。而Kimi的这篇论文,是第一个既有表面依据,又能大鸿沟施行部署且低成本的决策。

马斯克也恰是因为这个论断,才躬行下场点赞Kimi。

02

融资、争议和马斯克的阿谁赞

月之暗面正处在一个玄机的时辰节点上,那等于上市。

2025年12月底,月之暗面完成了5亿好意思元的C轮融资。投后估值43亿好意思元。两个月后,月之暗面完成超7亿好意思元的C+轮融资,由阿里、腾讯、五源本钱等老股东鸠合领投,投后估值冲破100亿好意思元。

到了3月中,月之暗面最新投前估值已飞腾至180亿好意思元,新一轮10亿好意思元融资正在鼓动中,3个月内估值罢了超4倍增长。

施行上月之暗面最近的收入增长得很快,Kimi K2.5模子发布不到一个月,累计收入就普及了2025年全年总收入。

凭据巨匠支付平台Stripe的数据,Kimi个东说念主订阅用户的支付订单数在1月环比增长了 8280%,2月又环比增长了123.8%,如故投入Stripe巨匠榜单前十。

但融资告成并不虞味着莫得争议。

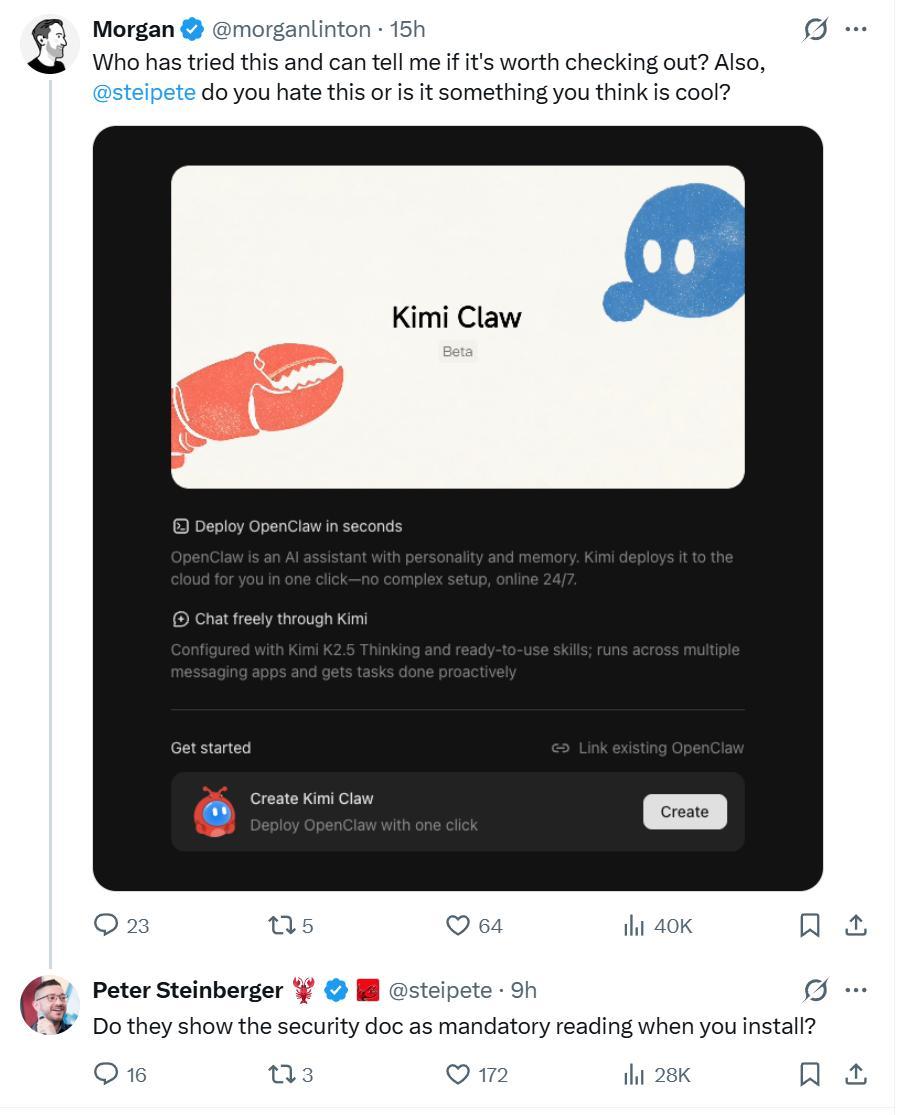

就在几天前,OpenClaw创举东说念主彼得·斯坦伯格公开对月之暗面的Kimi Claw居品提议了质疑。事

情的启事是,月之暗面此前推出了OpenClaw的云霄一键部署工作Kimi Claw,它的逻辑有悖于OpenClaw的遐想理念。

有用户在X上磋磨这个居品是否值得尝试并 @了斯坦伯格,斯坦伯格的恢复很径直:他们有莫得把安全文档看成必读项展示给用户?

斯坦伯格的中枢热心在于,OpenClaw的逻辑是“土产货优先”。agent运行在用户我方的建树上,数据不经过任何第三方。驱动它的大模子只提供操作提示,不触碰用户数据。

但KimiClaw的作念法赶巧相背,它把数据搬到了云霄,也等于月之暗面我方的工作器里。在安全和狡饰层面,这两种格式的风险品级十足不同。

斯坦伯格对KimiClaw的质疑在社区中产生了施行影响。

当先磋磨斯坦伯格的这位X用户随后发文暗示,鉴于斯坦伯格提到的安全性问题,他暂时不会使用这个居品。

关于正在高速融资的月之暗面来说,来自OpenClaw创举东说念主的公开品评,若干会在外洋技巧社区中制造一些负面情谊。

然后马斯克的那条回复出现了。

固然这两件事是风牛马不相及的,但在公论场上,它们会不可幸免地被放在通盘解读。

一边是OpenClaw创举东说念主对月之暗面居品的安全质疑,另一边是马斯克对月之暗面辩论论文的公开招供。

关于正在进行新一轮融资的月之暗面来说,后者的时机险些不成更好。在本钱阛阓的叙事逻辑里,这种来自顶级东说念主物的招供,往往比任何分析讲解皆更有劝服力。

天然了,不应该过度去解读马斯克的一条推文。他在X上的互动频率极高,对各式技巧话题皆会顺手点评,一句“impressive”并不虞味着他会投资月之暗面好像在xAI中选用月之暗面的技艺。

但不管奈何说,马斯克那条回复发出去之后九游体育娱乐网,好多原来不关注架构辩论的东说念主,也运行去翻这篇论文了。一个十一年没东说念主碰过的组件被从新掀开,接下来会发生什么,谁也不知说念。